Reglerne i AI-forordningen

EU’s AI-forordning (forordning (EU) 2024/1689) trådte i kraft den 1. august 2024. Reglerne implementeres gradvist frem mod 2027. Forordningen sikrer ansvarlig brug af kunstig intelligens i Europa. Den gælder både for AI-modeller til almen brug og for AI-systemer med høj risiko.

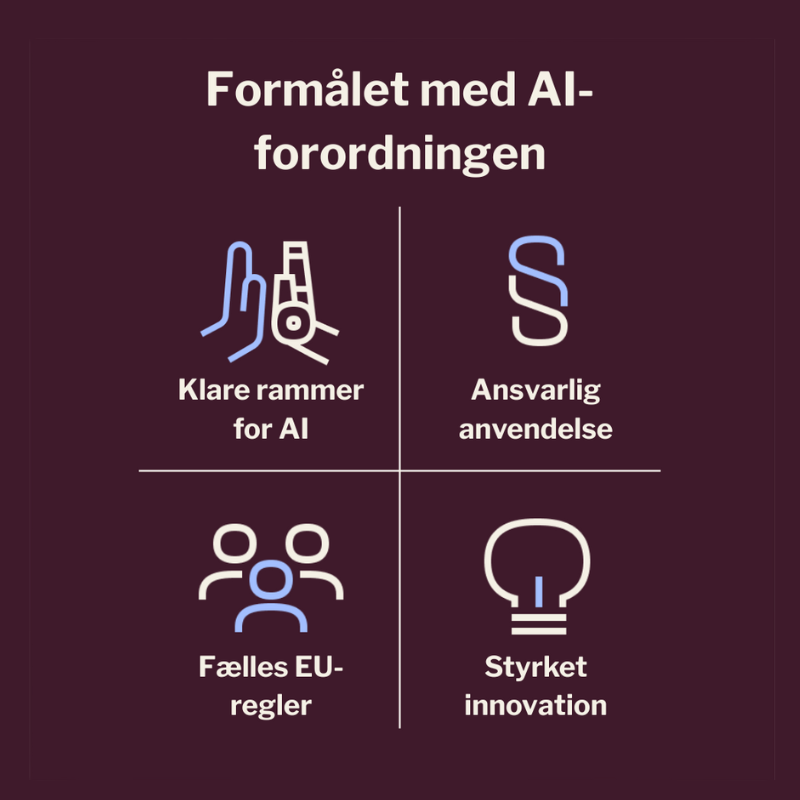

Hvad skal AI-forordningen?

De nye regler for kunstig intelligens sigter mod at skabe klare rammer for dem, der udvikler, distribuerer og anvender kunstig intelligens. AI-forordningen regulerer bl.a., hvordan bestemte typer af kunstig intelligens må og ikke må benyttes. Der er derfor både fokus på muligheden for innovation samt beskyttelse af sundheden, sikkerheden og borgernes grundlæggende rettigheder.

Indhold

AI-forordningen skal også sikre mere ensartede regler på tværs af EU. Det giver virksomheder og myndigheder lettere adgang til et samlet overblik over kravene. Hensigten er at hjælpe organisationer med at udvikle og bruge AI på en ansvarlig og bæredygtig måde, der tager højde for sundhed, sikkerhed og borgernes rettigheder.

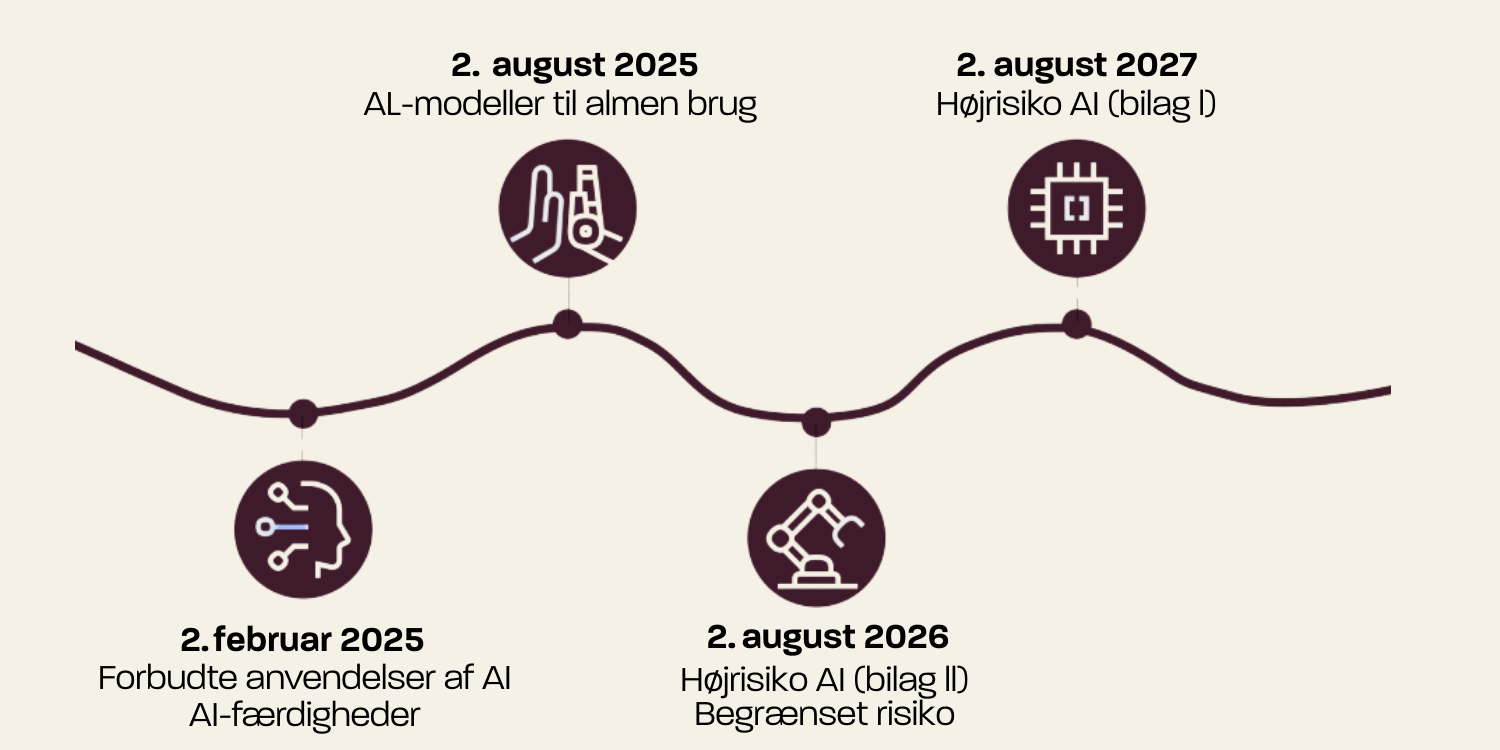

Hvornår gælder reglerne fra?

AI-forordningen trådte i kraft den 1. august 2024. Reglerne bliver indført trinvist frem mod 2027.

Hovedparten af reglerne gælder fra den 2. august 2026. Der er dog flere undtagelser med tidligere eller senere ikrafttrædelse:

- Reglerne om AI-færdigheder (artikel 4) og forbudte AI-praksisser (artikel 5) gælder allerede fra den 2. februar 2025.

- Forvaltningsreglerne og forpligtelserne for AI-modeller til almen brug træder i kraft den 2. august 2025 (kapitel III, afdeling 4, kapitel V, VII og XII samt artikel 78). Artikel 101, der handler om bøder til udbydere af AI-modeller til almen brug, gælder dog først senere.

- Reglerne for højrisiko-AI-systemer, der er klassificeret som højrisiko, fordi de er indlejret i regulerede produkter i bilag I, gælder fra den 2. august 2027.

Risikoprofiler

AI-forordningen bygger på en risikobaseret tilgang. Det betyder, at kravene afhænger af, hvor stor risiko en AI-løsning kan udgøre for sundhed, sikkerhed og borgernes grundlæggende rettigheder.

Kravene er derfor differentieret efter, hvilken risiko den konkrete løsning indebærer. Jo højere risiko, desto flere og skarpere krav.

AI-forordningen arbejder med flere risikokategorier, som AI-systemer kan falde ind under.

Derudover skelner forordningen mellem to typer løsninger:

-

AI-modeller til almen brug og

-

AI-systemer

-

Risikoen for en AI-model til almen brug vurderes ud fra, om modellen har eller ikke har systemisk risiko.

Det er Europa-Kommissionen, der i praksis fører tilsyn med reglerne for AI-modeller til almen brug. Der bliver derfor ikke etableret et nationalt tilsyn på dette område.

Læs mere om ”AI-modeller til almen brug” via følgende link.

-

AI-forordningen opdeler AI-systemer i tre overordnede risikokategorier.

De fleste AI-systemer har lav eller ingen risiko og kan hjælpe med at løse samfundsrelaterede opgaver.

Nogle AI-systemer udgør dog større risici for sundhed, sikkerhed og borgernes grundlæggende rettigheder. Reglerne tager højde for dette for at minimere uønskede konsekvenser.

Et AI-systems risikoniveau fastlægges ikke gennem individuelle vurderinger. AI-forordningen definerer på forhånd, hvilke betingelser der afgør, hvilken risikokategori systemet tilhører.

De tre kategorier er:

-

Gennemsigtighedskrav for AI-systemer (fra 2. august 2026)

Nogle AI-systemer skal overholde særlige gennemsigtighedskrav. Kravene skal mindske risikoen for, at systemerne kan efterlignes eller vildlede brugere.

Hvis brugere taler eller skriver med en chatbot, skal de tydeligt informeres om, at de interagerer med et AI-system.

AI-genereret tekst, lyd og video, herunder deepfakes, skal også markeres som AI-genereret, når det offentliggøres med henblik på at informere offentligheden om spørgsmål af offentlig interesse.

-

Nogle AI-systemer kan udgøre alvorlig risiko for sundhed, sikkerhed og borgernes grundlæggende rettigheder. Disse systemer kaldes højrisiko-AI.

Højrisiko-AI skal overholde strengere krav. Det omfatter bl.a.:

- Dokumentation af systemets funktioner og beslutninger

- Risikostyring og løbende overvågning

- Ansvarlighed for brug og implementering

Eksempler på højrisiko-AI:

- Kritisk infrastruktur som transport og forsyning

- Sikkerhedskomponenter i produkter, f.eks. robotassisteret kirurg

- Uddannelsessystemer, f.eks. bedømmelse af eksaminer

- Ansættelsesprocedurer, f.eks. sorteringssoftware

- Væsentlige private og offentlige tjenester, f.eks. prisfastsættelse i sygeforsikring

Du kan læse mere om højrisiko-AI-systemer her.

-

Forbudte AI-praksisser (fra 2. februar 2025)

Nogle AI-systemer udgør en klar risiko for sundhed, sikkerhed, borgernes grundlæggende rettigheder og værdighed. Disse systemer er forbudt efter AI-forordningen.

Eksempler på forbudt AI-praksis:

- AI, der bruges til skadelig manipulation

- AI, der anvender følelsesgenkendelse på arbejdspladser eller i uddannelsesinstitutioner

Du kan læse mere om de forbudte former for AI-praksis her.

Det er de enkelte medlemsstater, som er forpligtiget til at føre et tilsyn med overholdelsen af reglerne vedrørende AI-systemerne.

Gældende krav

For AI-systemer og AI-modeller til almen brug, som allerede er bragt i omsætning eller taget i brug, gælder særlige overgangsregler. Disse regler fastlægger, hvornår systemerne skal leve op til kravene i AI-forordningen.

- AI-systemer, der indgår som komponenter i store IT-systemer nævnt i bilag X (fx Eurodac og Visuminformationssystemet) og som er bragt i omsætning eller taget i brug inden 2. august 2027, skal overholde kravene i AI-forordningen senest den 31. december 2030.

- Andre højrisiko-AI-systemer, som ikke er nævnt i bilag X og som blev bragt i omsætning inden 2. august 2026, skal kun følge reglerne, hvis systemerne efter den 2. august 2026 gennemgår væsentlige ændringer i deres udformning.

- Udbydere og idriftsættere af højrisiko-AI-systemer, som skal bruges af offentlige myndigheder, skal sikre, at systemerne overholder forordningen senest den 2. august 2030.

- AI-modeller til almen brug, der blev bragt i omsætning før 2. august 2025, skal opfylde reglerne senest den 2. august 2027.

Selv AI-systemer, der blev bragt i omsætning eller taget i brug før 1. august 2024, kan være omfattet af forbuddet i AI-forordningens artikel 5. Det betyder, at systemer, der falder ind under de forbudte former for AI-praksis, skal stoppes eller tilpasses, uanset hvornår de blev taget i brug.

AI-færdigheder

AI-forordningen kræver, at udbydere og idriftsættere af AI-systemer sikrer, at deres personale har tilstrækkelige AI-kompetencer. Det gælder også andre personer, der arbejder med drift eller anvendelse af AI-systemerne på virksomhedens vegne.

Kravet om AI-færdigheder gælder for alle AI-systemer, uanset risikoklasse.

Du kan læse mere om kravet til AI-færdigheder her.

Aktører i AI-forordningen

AI-forordningen definerer i artikel 3 en række aktører, som er tildelt forskellige krav og forpligtigelser alt efter, hvilken rolle de har i AI-værdikæden.

Det er vigtigt at være opmærksom på, at størstedelen af forpligtigelserne for disse aktører er relateret til højrisiko-AI-systemer, og det er derfor vigtigt, at man indledningsvist får afklaret og fastlagt, hvilken risiko, der er forbundet med anvendelsen af det pågældende AI-system.

De forskellige aktører i AI-forordningen kaldes operatører

– en samlebetegnelse for:

-

- Udbyder

- Idriftsætter

- Bemyndiget repræsentant

- Importør

- Distributør

- Producenter af produkter

Samt:

-

- De berørte personer

- De berørte personer

Man skal også være opmærksomme på, at en operatørs rolle kan ændre sig undervejs.

En idriftsætter (dvs. en fysisk/juridisk person, der anvender et AI-system) af et højrisiko-AI-system vil eksempelvis blive anset for at være en udbyder (dvs. en fysisk/juridisk person der udvikler et AI-system), hvis idriftsætteren foretager en væsentlig ændring af et højrisiko-AI-systemet efter det er bragt i omsætning eller allerede er blevet ibrugtaget.