Guide til myndigheder

Denne guide er til myndigheder, der vil vide mere om, hvordan man ansvarligt kan anvende generative kunstig intelligens-værktøjer.

Udviklingen inden for generativ kunstig intelligens (AI) går stærkt. Efter lanceringen af ChatGPT i oktober 2022 er antallet af generative AI-værktøjer og deres funktionalitet vokset markant. Uanset om jeres organisation har taget stilling til brugen af generativ AI eller ej, så er der en god sandsynlighed for, at flere medarbejdere i organisationen allerede bruger det – og med god grund. Generativ AI åbner op for nye måder at løse opgaver på. Hvad end det omhandler effektivisering af tidskrævende manuelle arbejdsopgaver, finde mønstre i store mængder data, komme med nye ideer eller understøtte mere komplekse opgaver såsom kodning til programmering, er der muligheder.

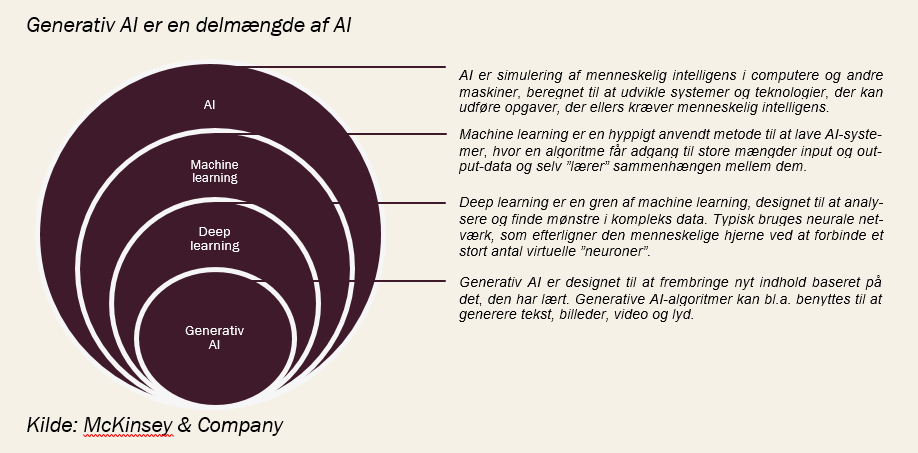

Hvad er generativ AI?

Ansvarlig anvendelse af AI er et ledelsesansvar

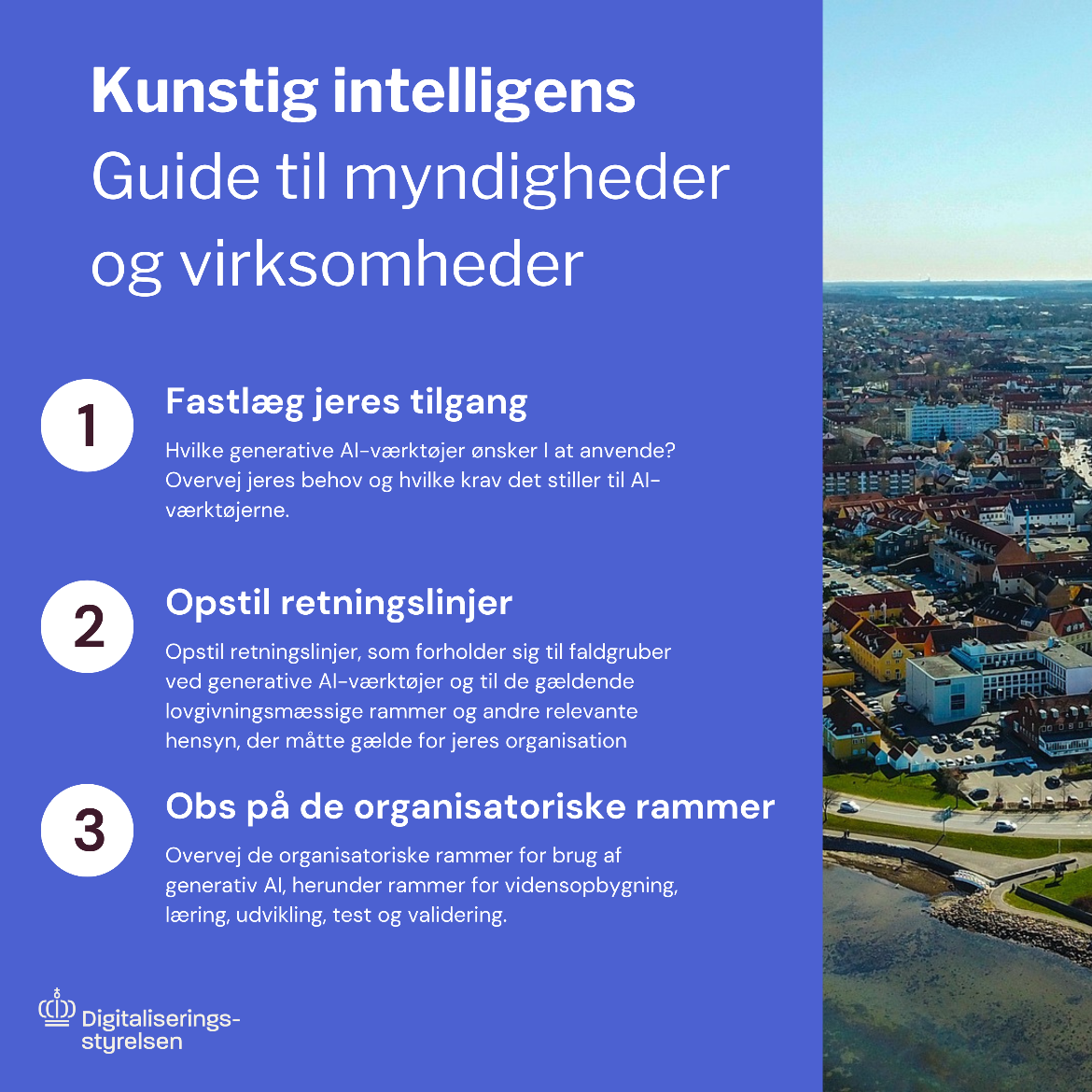

Det er et ledelsesmæssigt ansvar at sikre, at anvendelsen af generativ AI sker på en ansvarlig måde. Til inspiration kan I som virksomhed gå til opgaven ved

1) Først at tage stilling til, hvilken TILGANG til generative AI-værktøjer, der passer til jeres virksomheds formål

2) Dernæst at lave RETNINGSLINJER tilpasset jeres valg af generative AI-værktøjer og jeres kontekst med blik for mulighederne, men også med særlig fokus på generelle faldgruber ved generativ AI og de lovgivningsmæssige og kontraktuelle hensyn i jeres virksomhed

3) Fastlægge hvordan I som virksomhed understøtter det i praksis gennem ORGANISATORISKE RAMMER for ibrugtagning af ny teknologi.

Guiden er henvendt til ledere i offentlige myndigheder. Den skal give inspiration til overvejelser i forbindelse med ibrugtagning af generativ AI. Guiden er en hjælp til at konkretisere anvendelsesformål og tilgange, udforme retningslinjer og overveje understøttende organisatoriske tiltag. Det er den enkelte myndigheds ansvar at sikre, at anvendelsen af generativ AI sker ansvarligt.

Guiden vil løbende blive opdateret. Det skyldes både, at den teknologiske udvikling inden for generativ AI går hurtigt, og at der i forbindelse med implementeringen af EU’s forordning om kunstig intelligens følger nye rammer og regler, som skal overholdes. Hold jer derfor løbende opdateret på nye versioner af denne guide.

Disse tre trin er illustreret ved billedet nedenfor og gennemgås efterfølgende enkeltvist i denne guide.

1. Tilgang til brugen af generative AI-værktøjer

Der findes mange anvendelsesmuligheder og forskellige typer af generative AI-værktøjer. Det er vigtigt, at I tager stilling til, hvad I ønsker at opnå, hvorvidt generativ AI kan anvendes hertil, og på den baggrund forholder jer til, hvilke krav det stiller til jeres valg af generative AI-værktøjer.

Først er det vigtigt at afgrænse, hvorvidt jeres forretningsbehov dækker over almen anvendelse, specialiseret projektanvendelse eller begge dele.

Afhængigt af jeres behov og de forvaltnings- og lovgivningsmæssige hensyn, der berøres i afsnit B, kan I vurdere hvilken teknisk løsning, I med fordel kan vælge. Her kan I overveje, hvorvidt jeres behov kan realiseres med en cloudtjeneste eller om I skal drive værktøjet lokalt, samt om I vil vælge en open eller closed source model.

2. Retningslinjer for brugen af generativ AI-værktøjer

Efter I har taget stilling til hvilke generative AI-værktøjer, der er relevante i jeres organisation og i relation til jeres forretningsbehov, anbefales det, at I udformer retningslinjer, der skal danne rammerne for brugen i jeres organisation.

I den forbindelse er det vigtigt, at I forholder jer til de faldgruber, der kan være ved anvendelse af generativ AI, samt relevante lovgivnings- og for-valtningsmæssige rammer.

Faldgruber ved generative AI-værktøjer

Selvom generativ AI har mange nyttige anvendelsesmuligheder, medfører måden de er opbygget samtidig en række faldgruber, som I med fordel kan forholde jer til. Det gælder særligt:

Det anbefales, at jeres retningslinjer tager højde for ovenstående faldgruber, fx gennem:

Lovgivnings- og forvaltningsmæssige rammer

Ud over faldgruberne er det vigtigt, at I sikrer jer, at jeres retningslinjer for brug af generativ AI stemmer overens med gældende lovgivnings- og forvaltningsmæssige rammer. Det omfatter både særlige regler på jeres område og derudover særligt databeskyttelsesretten, forvaltningsretten, og immaterialretten.

Det anbefales, at I som minimum forholder jer til følgende:

3. Organisatoriske rammer for ibrugtagning af ny teknologi

Udover at tage stilling til hvilke formål brugen af generativ AI skal tjene, hvilke AI-værktøjer, der kan anvendes i organisationen og hvilke retningslinjer, der skal gælde for brugen heraf, så er det som altid relevant at tage stilling til, hvordan I som organisation understøtter en ansvarlig anvendelse i praksis gennem organisatoriske rammer.

At bygge de rette organisatoriske rammer er essentielt for, at ibrugtagning af generativ AI bliver en succes i jeres organisation. Generelle erfaringer med ibrugtagning af ny teknologi tilsiger, at det er vigtigt fra starten af at tage stilling til bl.a., hvem der skal drive arbejdet, og hvordan de klædes på til det samt prioritering af ressourcer til bl.a. vidensopbygning, udvikling, test og validering. En tommelfingerregel ved indføring af ny teknologi er 80/20-reglen, der dækker over, at 80 pct. vedrører alt det rundt om – og kun 20 pct. vedrører selve teknologien.

Det anbefales derfor, at I husker at medregne understøttende faktorer fra starten. Det kan fx omhandle praktiske rammer som prioritering af ressourcer ved anvendelsen af generative AI-værktøjer, men også at fordre en god og konstruktiv dialog om erfaringer og overvejelser om brugen af generativ AI i jeres organisation. Jo større gennemsigtighed og åbenhed internt på tværs af organisation, desto bedre muligheder har I som ledelse for at sikre, at jeres rammer og retningslinjer afspejler de behov, erfaringer og opmærksomhedspunkter, der eksisterer i det daglige arbejde hos jeres medarbejdere. Samtidigt muliggør en åben dialog, at I som organisation løbende kan lære af jeres erfaringer og dermed blive endnu skarpere på anvendelsen af generativ AI.

Endelig er det et godt råd løbende at tage jeres valg af generative AI-værktøjer, retningslinjer og organisatoriske rammer op til revurdering, da både teknologien, de lovgivningsmæssige rammer og det kollektive erfaringsgrundlag med brug af generativ AI ændrer sig løbende.

-

Samuel Sloth Andersen

Titel: Fuldmægtig

E-mail: samand@digst.dk

Telefon: +45 20 56 10 12

-

Lærke Bennekou Jessen

Titel: Fuldmægtig

E-mail: laejes@digst.dk

Telefon: +45 21 66 16 24